A mobilos érintőképernyőt meghaladó fejlesztésnek tartják a Tokiói Egyetem kutatói azt a technológiát, melyről először év végén számoltak be egy japán lapban, majd a gigazine.net japán kiadásában.

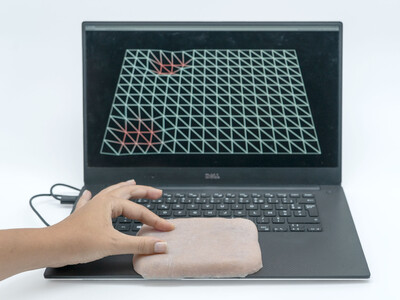

A megoldás lényege, hogy egy kamera segítségével a felhasználó ujjainak mozgását fordítják le számítógépes utasításokra. A fejlesztőcsapat vezetői, Maszatosi Isikava és Takasi Komuro „látvány-alapú beviteli eszköznek” (vision-based Input Interface) nevezték el a technológiát. Hasonló, a mozgást parancsokra átalakító megoldások léteznek már – az egyik legnagyobb sikert aratottról, az MIT-n fejlesztett „hatodik érzékről” az IT café is beszámolt –, ám a japánok által megalkotott módszer abban a lényeges tulajdonságban különbözik ezektől, hogy itt nem szükséges érzékelőket szerelni az ujjakra vagy a test más részeire. A 3D-s mozgást egy 154 fps frissítésű, kétlencsés (egy speciális szoftver segítségével egy lencsével is működő) kamera rögzíti.

A demó felhasználási területeket bemutató részei talán nem túl meggyőzőek – hogy miért is jó az érintőképernyő fölött mutogatni, ahelyett, hogy a szokásos módon, tapogatva adnánk utasításokat –, de az mindenképp figyelemre méltó, hogy érzékelők nélkül sikerült megoldani a mozgások értelmezését, s a jövőben valószínűleg ez a technológia is megtalálja a maga célterületét.